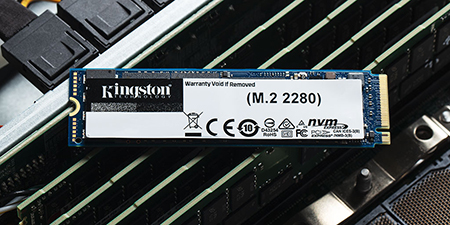

提高 SATA 接口性能的能力会减缓多数数据中心采用 NVMe 技术的进展。当您使用 SATA 等速度较慢的技术时,提高容量、提升性能、提高 IOPS 或降低延迟会更加容易。纵观当今的数据中心,多数数据中心架构师专注于提高 CPU 利用率。即便满机配置安装昂贵的 CPU(不计内核数量或支付的许可成本),数据中心也很少能将 CPU 利用率提高接近 CPU 最大容量 30% 的水平。

就像您购买了满屋子的法拉利,但只能以 20 英里/小时的速度行驶。这不是福特与法拉利的对决,而是无铅与高辛烷的对比。

NVMe 正在推动传输速度和内存预留的新变化,让您可以将利用率从 30% 提高到近 60%,增加近一倍。利用现有的基础设施,NVMe 可以让 CPU 更高效地运行,同时降低延迟并提高吞吐能力。不过,您必须能够采用 NVMe。限制因素可能包含您的现有背板,或无法按现有外形尺寸插入和更换。这变成了更大规模的整改。

要迁出基于 SAS 的系统,除非使用适配器将 NVMe 固态硬盘安装到 PCIe 总线上,否则服务器的架构必须改变。对于客户而言,这将是全面的平台调整。与使用 SATA 和 SAS 基于硬件的主机控制器不同,PCIe 接口基于软件,可为专用处理器提供更高效率。NVMe 在低延迟和 CPU 多线程能力方面表现惊人。

现在,您要问的下个问题可能是“现在什么更重要?升级整台车,还是对发动机涡轮增压?”